Blindes Grauen

- Home

- /

- Portfolio

- /

- Interaktion

- /

- Blindes Grauen

Blindes Grauen

eine interaktive, Auditive Horror-installation

TEAM: Lydia Friedrich | Jenny Joost | Markus Matt | Waldemar Rose

Meine Rolle

Konzept | UX Design

Projekthintergrund

Das Projekt »Blindes Grauen« entstand im WS 15/16 in der Masterveranstaltung »Interaktionsdesign« mit dem Thema “Invisible Interfaces: Interfaces ohne digitales Display”.

Projektherausforderung

Die Herausforderung bestand darin, dass das zu konzipierende Interface ohne ein Digitales Display auskommen musste. Eine weitere Hürde ergab sich daraus, dass auf klassische Eingabegeräte, wie z. B. eine Maus, eine Tastatur oder ein Touchdisplay, verzichtet werden sollte.

Ziele

Neben dem Entwurf eines Invisible Interfaces und der Entwicklung eines Prototypen, war es unser Ziel ein intensives Horror-Erlebnis zu gestalten. Während des Gangs durch das Labyrinth sollen sich die Nutzer durch die produzierte Atmosphäre in die Situation einfinden und dieses am eigenen Körper empfinden, denn schließlich sind sie selbst Protagonisten der Horror-Geschichte.

Die IDEE

“Führung und Steuerung einer Person durch den Raum mittels auditiven Feedbacks.”

Um die Idee in einen spannenden Kontext zu bringen, haben wir uns dazu entschlossen, ein auditives Horror Labyrinth umzusetzen. Dabei soll der Grundgedanke des Labyrinths mit der Idee der Interaktion in einem imaginierten Raum verbunden werden: Der Teilnehmer befindet sich in einem dunklen Raum innerhalb eines imaginären Labyrinths und muss mittels auditiven Feedbacks dieses blind durchqueren. Der Nutzer wird dabei gleichzeitig in eine Horrorgeschichte eingebunden und hat somit aktiv Einfluss auf das weitere Geschehen der Geschichte.

Während der Teilnehmer sich blind durch den Raum bewegt, erhält er auditive Informationen über seine momentane Situation und welche Möglichkeiten ihm zur Verfügung stehen. Und kann mit Hilfe seiner Kreativität die Geschichte real werden lassen.

Zielgruppe

Die Installation richtet sich zum Teil an Menschen aus der Gruppe der Performer, welche den neuen Medien gegenüber sehr aufgeschlossen sind und diese intensiv nutzen. Sie sind dazu bereit, neue Dinge auszuprobieren und zu erleben. Eine weitere Zielgruppe ist die Schnittmenge aus der Bürgerlichen-Mitte und den Adaptiven-Pragmatikern, welche sich von den Performern u. a. durch ihre geringere Risikobereitschaft unterscheiden lassen. Dennoch nutzen sie die neuen Medien und haben eine Tendenz zur Neuorientierung. Ebenfalls in der Zielgruppe enthalten sind die jungen Menschen der Expeditiven, welche die digitalen Techniken beherrschen, wenig gebunden und stets offen für Neues sind.

Im Rahmen des Projektes war es mir nicht möglich Benutzerverhalten, -bedürfnisse sowie -motivationen der Zielgruppe zu erforschen, da diese nicht in die Aufgabenstellung inkludiert waren. Stattdessen schrieb ich eine fiktive Persona, welche es mir erleichterte mich in den Nutzer hineinzuversetzen und mit dieser das spätere Nutzungsszenario zu durchlaufen.

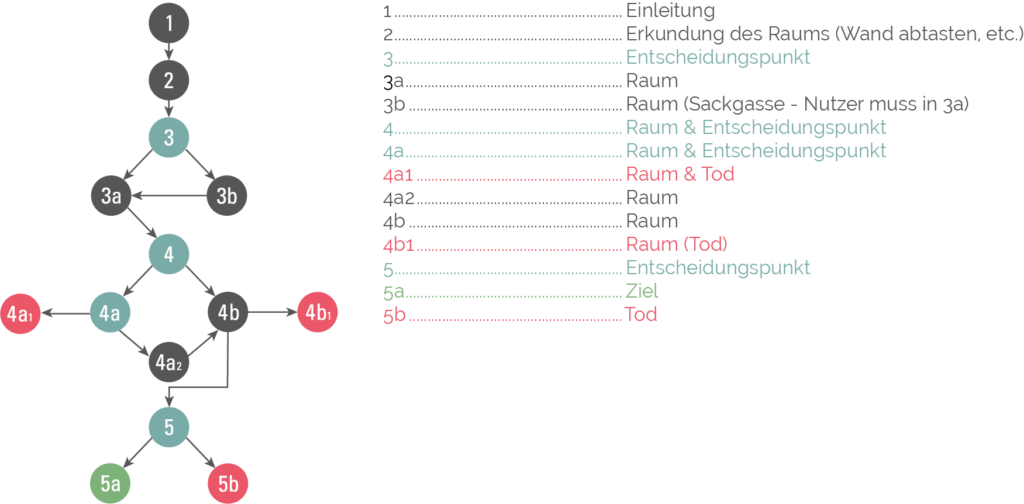

Ablaufdiagramm

Im nächsten Schritt erarbeitete ich, im Rahmen des Konzepts der Installation, ein Ablaufdiagramm. Dieses stellt eine nonlineare Geschichte mit Endscheidungspunkten dar.

Die Pfeile geben an, in welche Richtung sich die Geschichte weiter entwickeln könnte und jeder Knotenpunkt enthält einen bestimmten Teil der Geschichte. Es befindet sich auch ein Sackgassenpfad im Ablaufdiagramm (Raum 3b), bei diesem war es von äußerster Wichtigkeit, den Inhalt des Knotenpunkts mit keinen relevanten Informationen auszufüllen, die zum Verstehen der Geschichte notwendig sind. Da nicht ausgeschlossen werden kann, dass der Nutzer diesen Pfad nicht betritt und somit einen Teil der Geschichte verpassen würde.

Geschichte

Nachdem die Geschichte vollendet war, wurde unter Zuhilfenahme des Ablaufdiagramms, das Drehbuch geschrieben (Markus Matt), welches widerrum als Vorlage dazu diente, die Texte im Tonstudio aufzunehmen.

„Im Jahre 1853 begann der Knabe Joseph Hinz seine Ausbildung zum Uhrmacher an der Uhrmacherschule in Furtwangen. Joseph war ein Einzelgänger, von schmächtiger Statur und nahezu unscheinbar. Dennoch wurde er zum Hassobjekt seiner Mitschüler der Uhrmacherschule und musste viel Gelächter und Schimpftriaden über sich ergehen lassen. So kam es, dass Joseph sich immer mehr und mehr von den Menschen in seiner Umgebung zurückzog. Um allen zu beweisen, welches Unrecht sie ihm antaten, begann er mit der Herstellung einer perfekten Uhr…der Meisteruhr. Er investierte viel Zeit und Mühe in seine Uhr, doch kein Uhrwerk, das er kreierte, konnte ihn zufriedenstellen, denn alle verloren nach der Zeit ihren Takt. Da kam ihm ein Gedanke…

Dieser Gedanke keimte zunächst nur ein klein wenig in seinem Kopf, bis er anfing zu wachsen…bis ins Unermäßliche… ein Herz, der perfekte Taktgeber…das Pochen so gleichmäßig, so unbeschreiblich schön, so perfekt…“

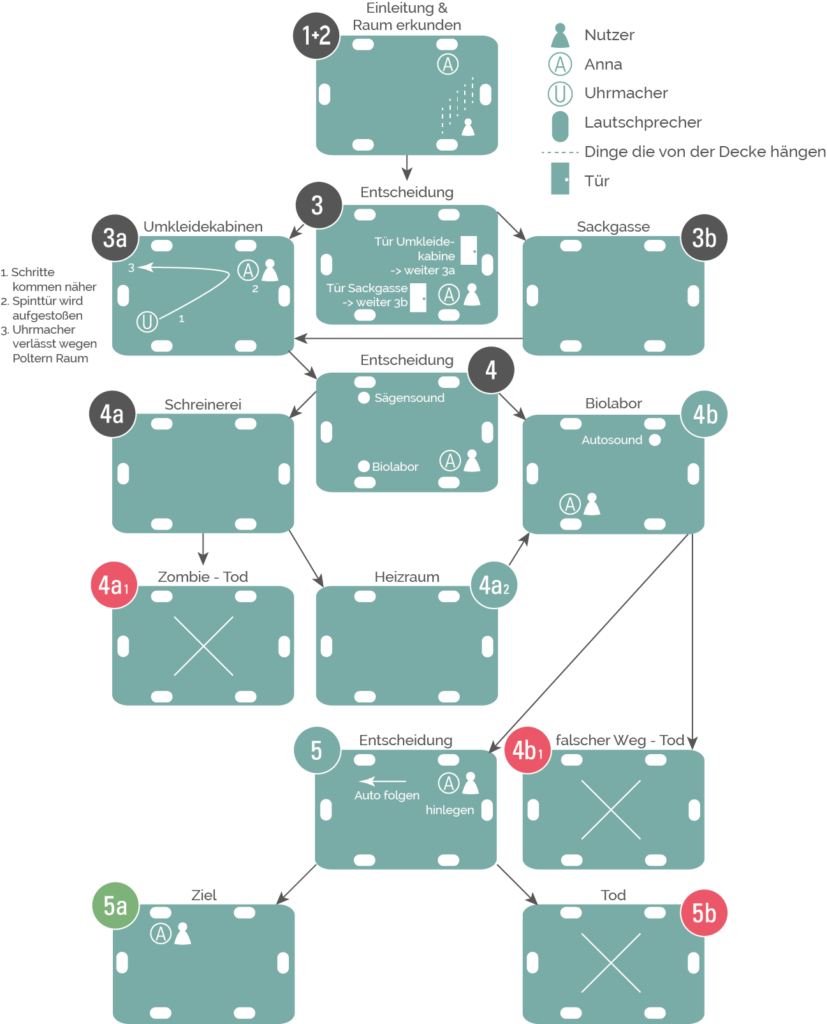

Nutzungsszenario

Unter zu Hilfenahme des Ablaufdiagramms, und der Geschichte, begann ich ein erstes Nutzungsszenario zu schreiben. Dieses half dem Team einerseits ein besseres Bild von der Installation selbst zu bekommen und zum anderen deckte das Nutzungsszenario in seinen Durchläufen mehrere Probleme auf, welche wir dann beheben konnten.

Im Zusammenspiel mit dem fertigen Nutzungsszenario entwickelte ich dann ein Storyboard für die Handlungsmöglichkeiten des Nutzers. In diesem Storyboard wurden allerdings keine Bildmotive skizziert, sondern die möglichen Bewegungen des Nutzers aus dem Nutzungsszenario, in Kombination mit den Lautsprechern. Dieses Storyboard bildete auch die Grundlage für weitere Interaktionsmöglichkeiten des Nutzers. Denn nur wenn klar ist, wie der Nutzer sich durch den Raum bewegt, können die Audiosignale zum aktuellen Standort des Nutzers räumlich auf der 7.1 surround Soundanlage verortet werden. Zudem war eine Visualisierung der möglichen Laufwege des Nutzers wichtig, um teamintern eine einheitliche Vorstellung des Ablaufs des Hörspiels zu erhalten.

Sounds

Bei den Sounds handelt es sich in der Regel um Umgebungsgeräusche, die das von den Nutzern imaginierte Bild des Raumes schärfen sollen. Die Bandbreite der genutzten Sounds ist hierbei denkbar vielfältig. Von Schritten über sich öffnende Türen, bellenden Hunden und stechenden Kreissägengeräusche bis hin zu Wasserhahntropfen wurden Unmengen an Sounds dazu genutzt, vordefinierte und konzipierte Orte, auditiv zu gestalten.

Entwicklung

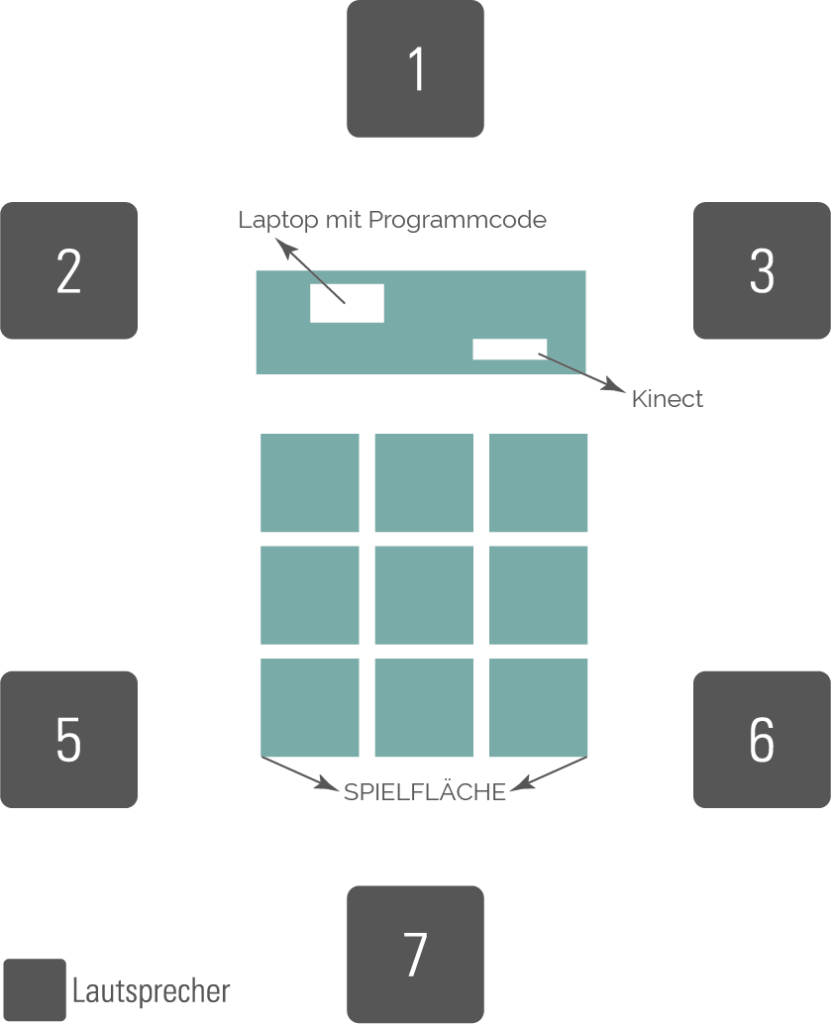

Der Umgang mit der Kinect, mit der entsprechenden SDK (Standart Development Kit), war für unsere geübten/erfahrenen Programmierer (Waldemar Rose | Jenny Joost) schnell zu erlernen.

Während des gesamten Projekts, arbeitete die Designunit eng mit der Entwicklungsunit zusammen. So konnten wir gegenseitig Einfluss auf den Verlauf des Projektes nehmen.

Nutzung der Installation

Bei der Installation handelt sich um eine Art Spiel, bei welchem der Nutzer mittels seiner Bewegung im Raum, mit der Installation interagieren kann (siehe Nutzungsszenario). Hierbei ist anzumerken das jeweils nur eine Person mit der Installation interagieren kann. Diese Interaktionen finden innerhalb eines 9×9 Rasters statt, in welchem sich der Nutzer frei bewegen kann und gleichzeitig von der Kinect erfasst wird.

ZUSTAND 1 – dem Sprechertext zuhören:

Innerhalb dieses Zustands bewegt sich der Nutzer nicht und hört sich einen Teil der Geschichte an.

ZUSTAND 2 – Suche nach dem nächsten Ereignis:

Der Nutzer bewegt sich durch den Raum, bis das nächste Ereignis (Sprechertext) ausgelöst wird.

ZUSTAND 3 – Aufforderung sich zu bewegen:

Sollte der Nutzer nicht auf die Anweisungen des Sprechers innerhalb der Geschichte reagieren, erhält er solange eine Aufforderung sich zu entscheiden oder zu bewegen (abhängig vom Teil der Geschichte), bis er tatsächlich tut.

ZUSTAND 4 – Aufforderung stehen zu bleiben:

Sofern der Teilnehmer sich nach Einsetzen des Sprechertextes weiter durch den Raum bewegen, ertönt solange eine Signalton, bis der Nutzer tatsächlich stehen bleibt.

Die Joy of Use wird durch verschiedene Faktoren beeinflusst: Bei der Nutzung der Installation wird Spannung und Spaß, auf Grund einer nonlinearen Geschichte, generiert. Die Herausforderung für den Nutzer besteht darin, sich mittels auditiven Feedbacks durch den Raum zu bewegen. Zudem besitzt die Installation ein sehr einfaches Spielprinzip: Entweder der Nutzer hört dem Gesprochenen zu oder er begibt sich auf die Suche nach dem nächsten Ereignis. Hat er dieses Prinzip einmal verstanden, ist der Rest der Installation selbst erklärend. Durch ein konsistentes Sound-Design, erhält der Nutzer zudem die Möglichkeit sich emotional in die Geschichte einbinden zu lassen. So soll ein möglichst intensives und eingehendes Erlebnis für den Nutzer gestaltet werden: die Zielgruppe erfährt Horror an ihren eigenen Körpern und werden somit zur aktiven Spielfigur, inmitten einer interaktiven Geschichte.

testdurchgänge

1. BLINDE ORIENTIERUNG ANHAND VON GERÄUSCHEN

Ein erster wichtiger Test war die Prüfung, wie genau eine Person mit verbundenen Augen die Position einer Geräuschquelle erkennen kann. Anhand eines einfachen Tests – eine Person mit verbundenen Augen steht im Raum und vier weitere Personen rufen in unterschiedlicher Reihenfolge: “Komm hier rüber” – stellte sich heraus, dass die Testperson die Position der Geräusche und Stimmen räumlich sehr gut verorten konnte. Wir versuchten diesem Problem vorzubeugen, indem wir die Nutzer vor dem Beginn des Spiels, mehrmals im Kreis drehten. Ebenso stellten wir fest, dass kleine Geräusche, der sich zusätzlich im Raum befindenden Personen, eine grobe Orientierung im Raum wieder ermöglichten. Jegliche, nicht zum Spiel gehörende Geräusche sollten also vermieden werden.

2. GRÖßE DES SPIELFELDS

Bei einigen Testdurchläufen fiel auf, dass der Nutzer sich an die Dunkelheit gewöhnt und sich mit der Zeit schneller und unvorsichtiger bewegt, als in kürzeren Tests zuvor ermittelt. Dadurch wurde das Spielfeld schnell zu klein und wir erweiterten die Fläche auf die maximale Reichweite (drei mal drei Meter) der Kinect.

3. WAHRNEHMUNG DER INHALTE

Obwohl man meinen sollte, der Nutzer konzentriere sich voll und ganz auf das Hörspiel, stellte das Projektteam dennoch fest, dass manchmal Aufforderungen – wie zum Beispiel von Anna: “Was meinst du, welchem Geräusch sollen wir folgen, dem Blubbern oder den Sägen?” – nicht als Handlungsaufforderungen wahrgenommen wurden. Teilweise hatte das Projektteam das Gefühl, dass aufgrund der Spannung oder der ungewohnten Spielsteuerung Teile des Hörspiels nicht wahrgenommen wurden. In der letztendlichen Anwendung wurden daher zusätzliche optional abspielbare Aussagen integriert. Zum Beispiel: “Komm schon, du musst dich entscheiden”.

4. AUDITIVES FEEDBACK

Bei den Testdurchläufen wurde festgestellt, dass Nutzer teilweise immer weiter durch den Raum laufen. Obwohl versucht wurde durch Aussagen im Hörspiel dem Nutzer zu verdeutlichen, dass dieser das Zwischenziel erreicht hat, liefen Probanden teilweise weiter durch den Raum. Aussagen wie: “Sehr gut, nun befinden wir uns in Raum xy.” reichten nicht aus. Der Nutzer benötigt ein eindeutiges “Haltesignal”. Dieses fügten wir in Form eines Signaltons in das Hörspiel ein.

Prototyp

Der Prototyp der Installation wurde am Tag der Medien in der Hochschule Furtwangen vorgestellt und konnte hier von den Studierenden und Interessenten getestet werden.

Nutzungseindrücke

Nach jedem Durchgang wurde der Nutzer zum subjektiven Erleben der Installation befragt. Der Gesamteindruck war durchweg positiv und alle Teilnehmer betonten, dass eine solche oder ähnliche Installation für sie völlig neu sei. Als leicht verbesserungswürdig wurde teilweise die Komplexität des Auditiven angesehen. Hier wünschten sich einzelne Teilnehmer vielfältigere und lautere Umgebungs- / Atmogeräusche. Teilweise fiel auf, dass die Lautsprecher der Anlage alle in einer Höhe von etwa drei Metern an der Wand angebracht waren. Eine Anbringung auf Kopfhöhe und zusätzlich ggf. Lautsprecher an der Decke und auf dem Boden wären optimal. Positiv wurde die fehlende Orientierung / das fehlende Positionsbewusstsein im Raum bewertet.